AI‑agenten maken snel de overgang van indrukwekkende demo’s naar echte hulpmiddelen die namens u kunnen handelen, en OpenClaw is een van de namen die de laatste belangstelling aanjaagt. U hebt deze software misschien ook voorbij zien komen onder namen als Clawdbot en Moltbot — verschillende namen die de Oostenrijkse ontwikkelaar Peter Steinberger tijdens de ontwikkeling gebruikte.

Geadverteerd als een volledig geautomatiseerde persoonlijke assistent die software voor u kan bedienen, roept het ook belangrijke vragen op over toegang en veiligheid.

- AI‑agenten zijn actiegerichte AI‑systemen, niet alleen gesprekshulpmiddelen.

- Tools zoals OpenClaw laten zien hoe krachtig zelfgehoste AI‑agenten kunnen zijn.

- Die kracht brengt nieuwe veiligheidsrisico’s met zich mee wanneer agenten onbetrouwbare input verwerken.

- Prompt‑injectie is een belangrijke dreiging voor AI‑agenten, zelfs meer dan voor chatbots.

- Persistent geheugen kan fouten versterken en aanvallen verlengen.

- AI‑agenten zijn krachtig, maar geen veilige standaardkeuze voor de meeste consumenten.

Waarom krijgt OpenClaw zoveel aandacht?

OpenClaw trekt aandacht omdat het een omslag laat zien van AI die vragen beantwoordt naar AI die daadwerkelijk taken op een echt systeem uitvoert en zelfs software kan gebruiken. Die potentiële veiligheidsproblemen zorgen ervoor dat OpenClaw meer besproken wordt binnen beveiligingskringen. Wat maakt OpenClaw aantrekkelijk voor ontwikkelaars en gevorderde gebruikers?

OpenClaw valt op doordat het echte acties kan uitvoeren, niet alleen tekst of suggesties kan genereren. In plaats van u te vertellen wat u moet doen, kan het dingen zelf doen. De technologie kan apps openen, berichten versturen, bestanden verplaatsen, commando’s uitvoeren en direct met systemen interageren namens u.

Dat niveau van automatisering trekt belangstelling. Ontwikkelaars en gevorderde gebruikers zien controle op systeemniveau als een manier om repetitief werk te verminderen of workflows te automatiseren. Het idee van een AI‑agent die ‘het werk doet’ in plaats van alleen advies te geven, spreekt aan.

Die belofte van hands‑on mogelijkheden is waarom OpenClaw snel van nicheproject naar bredere discussie is gegaan.

Waarom dit verder gaat dan alleen OpenClaw

OpenClaw is een duidelijk voorbeeld van een grotere verschuiving naar AI‑agenten die daadwerkelijk handelen, niet alleen reageren of adviseren.

Vragen over mogelijk misbruik worden onvermijdelijk zodra dit soort technologie groeit. Wat OpenClaw laat zien, is waar AI naartoe beweegt. Dat maakt het relevant ver buiten één project en zet de toon voor lopende discussies over hoe deze agenten gecontroleerd moeten worden. Kunnen ze vertrouwd worden?

Wat zijn AI‑agenten en wat onderscheidt ze van andere AI‑tools?

AI‑agenten zijn systemen die niet alleen tekstuele of audioreacties op uw vragen geven. Ze kunnen actief stappen plannen en acties uitvoeren om een doel te bereiken. In plaats van bij advies te stoppen, beslissen ze wat de volgende stap is en voeren die uit.

Een AI‑agent kan een situatie observeren en actie ondernemen. Dat verschilt van de meeste AI‑tools, die wel op prompts reageren maar wachten op de volgende instructie. Vroege voorbeelden zijn taakuitvoerende agenten zoals Manus (nu in bezit van Meta). Manus laat zien hoe agenten van chat naar actie kunnen bewegen: het kan data analyseren of zelfs actief code schrijven om problemen op te lossen zonder expliciet te worden gevraagd wat te doen. Er is minder menselijke input nodig.

OpenClaw bouwt voort op hetzelfde idee van actiegerichte AI, maar past het op een directere en krachtigere manier toe.

Is OpenClaw een typische AI‑agent of iets geavanceerders?

OpenClaw valt binnen de categorie AI‑agenten. Het biedt een krachtigere uitvoering dan veel tools waarmee de meeste mensen nu bekend zijn.

Deze AI‑tool kan taken plannen en handelen zonder voortdurende input. OpenClaw kan direct met software en het besturingssysteem interacteren, en niet alleen met beperkte tools of API’s. Die bredere toegang vergroot de bruikbaarheid en onderscheidt het project. Tegelijkertijd verhoogt het ook de inzet en het belang van beveiliging.

Waarom zelfgehoste AI‑agenten anders zijn

Zelfgehoste AI‑agenten draaien lokaal op uw eigen systeem in plaats van op een externe dienst. Dat geeft gebruikers meer controle over zaken als configuratie en gedrag. Het verschuift ook de verantwoordelijkheid.

Wanneer een agent lokaal draait, hangt de veiligheid af van hoe hij is ingesteld, welke machtigingen hij heeft en hoe hij wordt gemonitord. Meer controle brengt meer risico’s met zich mee.

Recente projecten laten zien hoe het idee van ‘zelfgehost’ begint te veranderen. Zo kan Moltbot (voorheen Clawdbot) nu draaien met Cloudflare’s open source Moltworker. Dat maakt speciale lokale hardware overbodig omdat de agent op een beheerd platform kan draaien.

Dat verlaagt de instapdrempel en vereenvoudigt de setup, maar het verschuift ook waar de controle ligt. Als een agent op cloudinfrastructuur draait, hangt de veiligheid niet alleen af van de agent zelf, maar ook van toegangscontrole en hoe gegevens en rechten over het platform worden beheerd.

Zo kan een gebruiker een AI‑agent koppelen aan e‑mail in de veronderstelling dat deze alleen berichten leest, terwijl de cloudconfiguratie het ook toestaat om e‑mails te verzenden tenzij die toestemming expliciet is uitgeschakeld.

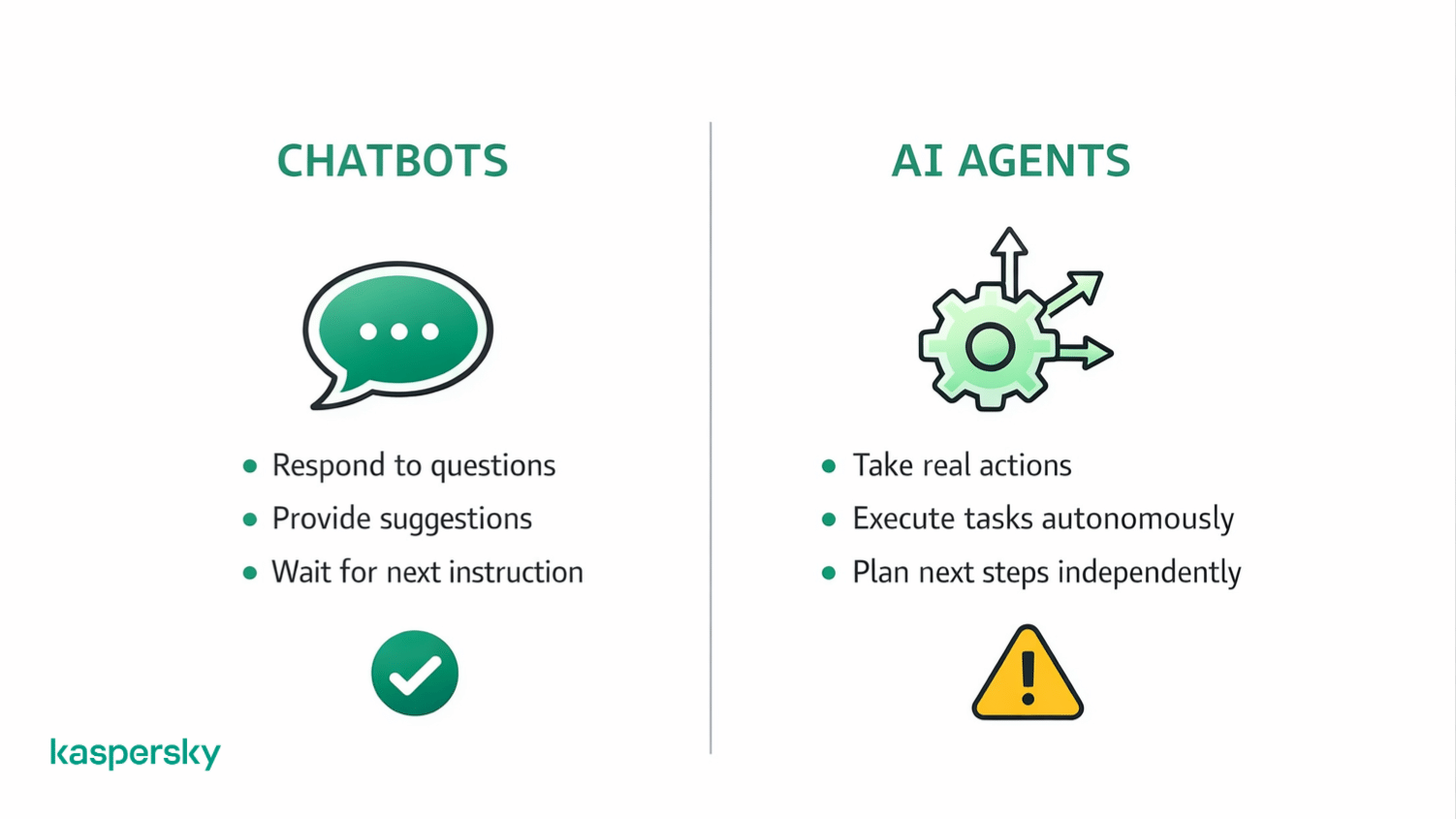

Hoe verschillen AI‑agenten van chatbots zoals ChatGPT?

Chatbots zoals ChatGPT reageren, terwijl AI‑agenten handelen.

Een chatbot kan suggesties of uitleg geven. Een AI‑agent kan actief programma’s openen of workflows doorlopen.

Als voorbeeld hebben sommige mensen OpenClaw gebruikt om beleggen te automatiseren. Ze hebben regels opgesteld en gevraagd aan AI om niet alleen advies te geven (dat kan een chatbot ook) maar daadwerkelijk transacties uit te voeren.

Waarom brengen AI‑agenten nieuwe veiligheidsrisico’s met zich mee?

Zoals eerder besproken voeren AI‑agenten acties uit in plaats van alleen advies te geven. Dat gaat vaak samen met toegang tot bestanden, applicaties of systeemsfuncties.

De systeemtoegang en autonomie die OpenClaw krijgt, veranderen zowel impact als risico. OpenClaw kan om toestemming vragen om met software te interacteren of acties uit te voeren zoals het versturen van een e‑mail of het invullen van formulieren zonder uw directe toezicht. Dat maakt het onvoorspelbaar.

Fouten of manipulatie kunnen echte gevolgen hebben. Het risico is niet alleen wat de agent opgedragen krijgt, maar ook wat hij als instructie interpreteert tijdens het uitvoeren van een taak.

Waarom onbetrouwbare input een kernprobleem is

AI‑agenten verwerken grote hoeveelheden externe content (zoals webpagina’s en documenten) om te beslissen wat ze vervolgens doen. Die content is niet altijd betrouwbaar.

Instructies hoeven niet direct te zijn. Ze kunnen verborgen zijn in tekst of data die de agent leest tijdens het uitvoeren van een taak. Hierdoor kunnen aanvallers het gedrag van een agent sturen zonder ooit rechtstreeks met die agent te hoeven communiceren.

Dit probleem opent een duidelijk pad naar prompt‑injectie: onbetrouwbare input wordt gebruikt om een agent te manipuleren en acties te laten uitvoeren die niet de bedoeling waren.

Krachtige AI‑tools vragen om sterkere bescherming

AI‑agenten kunnen toegang hebben tot bestanden, e‑mails en systeemsfuncties. Kaspersky Premium helpt verdachte activiteit te detecteren, kwaadaardige scripts te blokkeren en uw apparaten te beschermen tegen echte cyberbedreigingen.

Probeer Kaspersky Premium nu gratisWat is prompt‑injectie bij AI‑agenten?

Prompt‑injectie is een manier om een AI‑agent te manipuleren door hem onbetrouwbare content voor te schotelen die zijn gedrag verandert.

Het risico is niet per se een technische fout in code. Het probleem is dat de agent externe input kan behandelen als opdracht, zoals instant‑berichten of opmerkingen. Wanneer dat gebeurt, kan de agent worden gestuurd om acties uit te voeren waarvoor hij niet bedoeld was.

Hoe prompt‑injectie in de praktijk werkt

Prompt‑injectie kan direct of indirect plaatsvinden.

- Direct – een aanvaller voegt opzettelijk instructies toe aan content die de agent leest.

- Indirect – de agent pikt verborgen of onverwachte instructies op van een website of bericht dat hij tijdens normale taken verwerkt.

Het kernprobleem is gedrag. De agent kan volgen wat hij interpreteert als instructie, zelfs als die instructie uit onbetrouwbare bronnen kwam. Daarvoor is geen softwarefout nodig.

Waarom prompt‑injectie gevaarlijker is voor AI‑agenten dan voor chatbots

Geïnjecteerde instructies beïnvloeden bij chatbots meestal antwoorden en advies. Bij AI‑agenten kunnen ze acties beïnvloeden.

Als een agent toegang heeft tot bestanden of systeemcontroles, kunnen gemanipuleerde instructies tot echte veranderingen leiden. Daarom vormt prompt‑injectie een groter risico voor agenten. Dezelfde techniek die de tekstoutput van een chatbot verandert, kan bij een agent onbedoelde acties triggeren.

Wat is persistent geheugen bij AI‑agenten?

Persistent geheugen stelt een AI‑agent in staat om informatie in de loop van de tijd te bewaren. Dat betekent dat hij eerdere input kan gebruiken om toekomstige beslissingen te sturen, in plaats van bij elke taak opnieuw te beginnen.

Wat persistent geheugen betekent voor AI‑agenten

Een AI‑agent kan context en instructies over sessies heen opslaan en voorkeuren of ‘gedragingen’ ontwikkelen. Dat helpt de agent efficiënter te werken door te onthouden wat hij eerder heeft geleerd of gedaan.

Het betekent ook dat eerdere input later gedrag kan beïnvloeden. Instructies of aannames die in een eerdere taak zijn opgepikt, kunnen nog steeds bepalen hoe de agent handelt in een andere situatie, zelfs als de gebruiker zich dat niet meer realiseert.

Waarom persistent geheugen de veiligheidsrisico’s vergroot

Persistent geheugen kan vertraagde effecten introduceren. Een schadelijke instructie veroorzaakt misschien niet direct problemen, maar kan later weer naar boven komen als de omstandigheden daarvoor geschikt zijn.

Dat maakt opruimen lastiger. Het opgeslagen gedrag kan zich over meerdere taken herhalen. Een volledige herstelactie van een agent vereist vaak het wissen van het geheugen of het herbouwen van configuraties om ongewenste invloeden te verwijderen.

Wat gebeurt er als een AI‑agent verkeerd geconfigureerd is of wordt blootgesteld?

Een AI‑agent kan op manieren toegankelijk of beïnvloedbaar worden waarvoor de eigenaar nooit bedoeld had, waardoor een behulpzaam hulpmiddel een potentieel beveiligingsrisico wordt.

Dit kan gebeuren door een ongeluk of misverstand. Het kan ook gebeuren wanneer derden proberen de agent te manipuleren.

Hoe AI‑agenten onbedoeld blootgesteld kunnen raken

Blootstelling ontstaat vaak door simpele fouten. Zo kan zwakke authenticatie of te ruim toegewezen rechten ervoor zorgen dat een agent van buiten zijn bedoelde omgeving bereikbaar is.

Het draaien van een agent lokaal maakt hem niet automatisch veilig. Als hij verbinding maakt met internet of met andere systemen interageert, kan hij beïnvloed worden. Lokale controle vermindert sommige risico’s, maar sluit ze niet uit.

Waarom blootgestelde AI‑agenten aanvalsvlakken worden

Eenmaal blootgesteld wordt een AI‑agent iets wat aanvallers kunnen onderzoeken, testen en manipuleren. Ze kunnen proberen aangepaste input te voeden, acties te triggeren of te leren hoe de agent zich in de loop van de tijd gedraagt.

Aangezien agenten echte acties kunnen uitvoeren, hoeft misbruik er niet uit te zien als een traditionele hack. Misbruik kan bestaan uit het sturen van gedrag, het exfiltreren van gegevens of het veroorzaken van onbedoelde systeemwijzigingen, allemaal zonder een klassiek softwarelek te hoeven exploiteren.

Wat is de “dodelijke drie-eenheid” in de beveiliging van AI‑agenten?

De “dodelijke drie‑eenheid” beschrijft drie voorwaarden die samen een ernstig beveiligingsrisico voor AI‑agenten creëren.

De drie voorwaarden die ernstige aanvallen mogelijk maken

- De eerste voorwaarde is toegang tot gevoelige data, zoals bestanden, inloggegevens of interne informatie.

- De tweede is onbetrouwbare input, waarmee wordt bedoeld dat de agent content verwerkt die hij niet volledig kan verifiëren.

- De derde is de mogelijkheid om externe acties uit te voeren, zoals verzoeken versturen, systemen wijzigen of commando’s uitvoeren.

Per afzonderlijk onderdeel zijn deze factoren vaak beheersbaar. Ze worden gevaarlijk als ze samenkomen in deze drie‑eenheid. Een agent die onbetrouwbare input leest en daar acties op kan uitvoeren, biedt een duidelijk pad voor manipulatie. Beperken welke acties een agent mag uitvoeren is essentieel.

Moeten alledaagse gebruikers vandaag de dag AI‑agenten gebruiken?

Voor de meeste mensen zijn AI‑agenten nog experimentele tools. Ze kunnen in de juiste opzet nuttig zijn. Het nadeel? Ze brengen ook nieuwe risico’s met zich mee die niet altijd meteen duidelijk zijn.

Wanneer het gebruik van een AI‑agent zin kan hebben

Een AI‑agent kan zinvol zijn in gecontroleerde en laag‑risico scenario’s. Denk aan experimenteren op een apart apparaat. Sommige mensen draaien agenten die alleen niet‑gevoelige taken afhandelen, zoals het organiseren van bestanden of het testen van workflows.

Stel dat u de agent wilt gebruiken om een reisschema voor uw komende vakantie samen te stellen. De agent kan de benodigde informatie benaderen om dit te doen en worden verhinderd om direct contact met derden op te nemen of iets te doen dat veel schade kan veroorzaken.

Als u er comfortabel mee bent om instellingen te beheren en fouten niet hoogrisico zijn, kan een agent een leerzaam hulpmiddel zijn. Het belangrijkste is dat de scope klein blijft en de toegang strak beperkt wordt.

Wanneer AI‑agenten geen goed idee zijn

AI‑agenten zijn geen goede keuze wanneer ze toegang hebben tot gevoelige gegevens of belangrijke accounts. Agenten draaien zonder begrip van machtigingen of de gevaren van externe input verhoogt het risico snel.

Het is ook volkomen acceptabel om af te zien van gebruik. Besluiten om nu geen AI‑agent te draaien is een redelijke keuze als gemak ten koste gaat van veiligheid of gemoedsrust.

Welke basis‑veiligheidsmaatregelen zijn essentieel bij het gebruik van AI‑agenten?

Basisbeschermingen helpen risico’s te verminderen en voorkomen dat fouten ernstige problemen worden.

De software van Kaspersky kan een extra beschermingslaag bieden door verdachte gedragingen te signaleren en accounts te helpen beschermen tegen compromittering. Onze pakketten blokkeren alles van malware en virussen tot ransomware en spyware.

Welke veiligheidsmaatregelen het meest belangrijk zijn

Isolatie is cruciaal. Draai agenten op aparte apparaten en accounts wanneer mogelijk, zodat ze geen invloed kunnen hebben op belangrijke data of systemen. Beperk machtigingen tot alleen wat de agent echt nodig heeft. We raden af om standaard volledige systeem‑ of accounttoegang te geven.

Goedkeuringsstappen zijn ook belangrijk. Vereisen dat gevoelige acties eerst bevestigd worden, voegt een pauze toe die onbedoelde handelingen, zoals het aangaan van financiële verplichtingen, kan voorkomen. Deze eenvoudige controles hebben veel effect zonder veel complexiteit toe te voegen.

Wat betekenen AI‑agenten voor de toekomst van consumentengebruik van AI?

AI‑agenten wijzen op een toekomst waarin AI‑tools meer doen dan alleen assisteren. Ze ondernemen acties. Maar die verschuiving kent afwegingen waar consumenten nog aan moeten wennen.

Wat dit moment ons vertelt over de volwassenheid van AI‑agenten

AI‑agenten zijn krachtig maar nog onrijp. Ze kunnen taken automatiseren, maar worstelen nog met elementen van oordeel en veiligheid. Dat betekent niet dat agenten niet veiliger of betrouwbaarder zullen worden, maar wel dat verwachtingen realistisch moeten blijven.

AI‑agenten laten zien welke richting de ontwikkeling opgaat, maar wijdverspreid dagelijks gebruik vereist betere waarborgen en tools die veiligheid vanaf het begin meenemen in het ontwerp.

Gerelateerde artikelen:

- Hoe pakt ChatGPT cybersecurity‑zorgen en potentiële risico’s aan?

- Welke risico’s brengt AI‑cybercriminaliteit in het huidige digitale landschap?

- Hoe versterken AI en machine learning cybersecuritymaatregelen?

- Wat zijn de gevaren van deepfake‑technologie tegenwoordig?

Aanbevolen producten:

FAQs

Is OpenClaw gratis te downloaden?

OpenClaw is vrij te downloaden op GitHub. Het is open source software, wat betekent dat anderen de code kunnen aanpassen en opnieuw verspreiden.

Is OpenClaw makkelijk in te stellen?

Er zijn handleidingen waarmee men snel bots aan de praat kan krijgen, maar een geavanceerde setup vergt tijd en specialistische kennis. Dat maakt het juist risicovol om software te gebruiken die mogelijk niet goed is geconfigureerd.